Vos images quittent le DAM. Mais que deviennent leurs métadonnées ?

Une fois qu’un fichier sort d’un système de gestion des actifs numériques, les informations qui en garantissent l’origine et l’authenticité survivent rarement au voyage. Comment identifier la source d’une image quand tout a été effacé ? Et surtout, comment distinguer un contenu vérifiable et fiable d’une image malicieuse ou manipulée ? Une nouvelle génération d’outils apporte enfin des réponses concrètes.

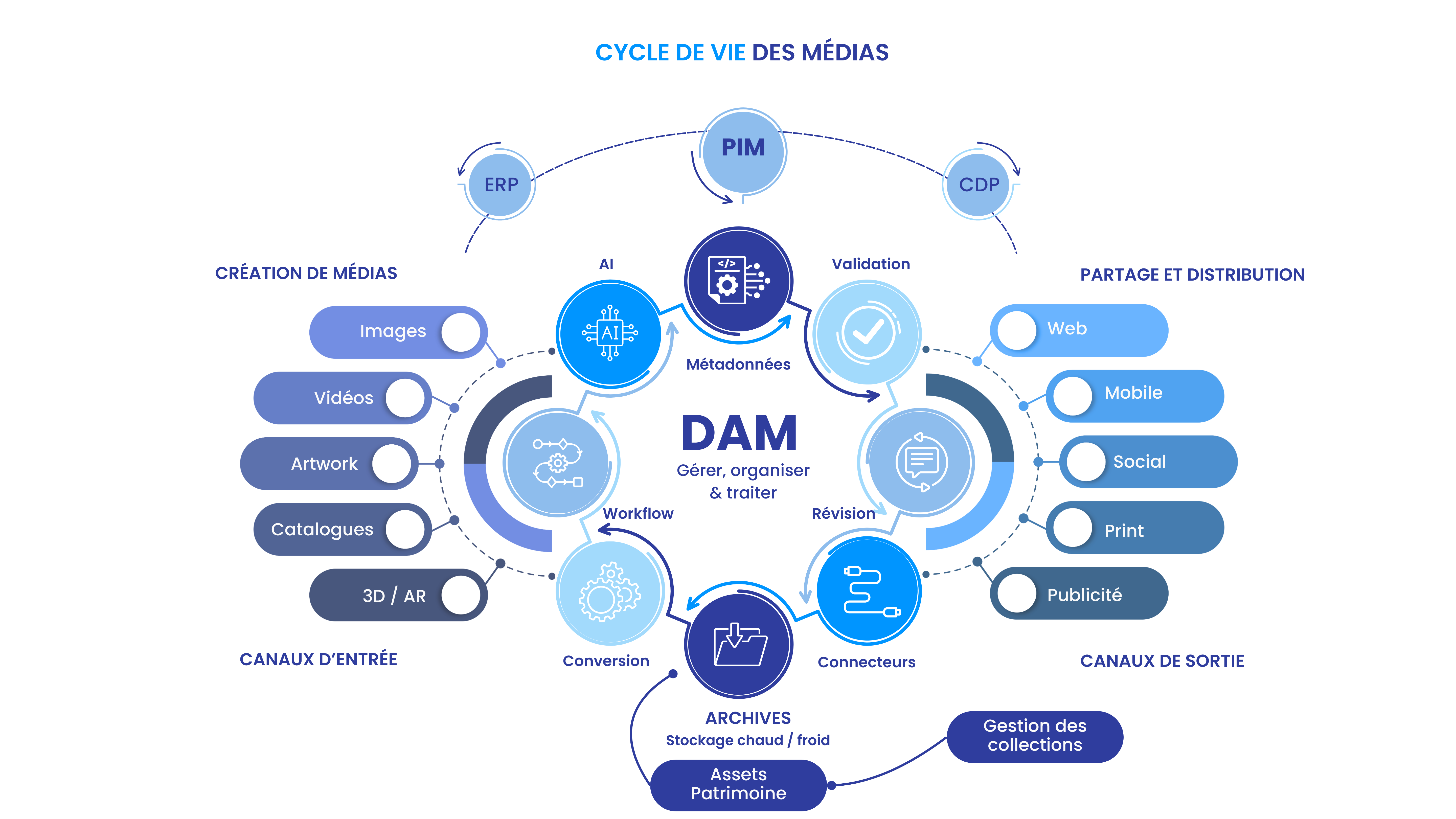

Imaginez le parcours d’une image dans une organisation typique. Elle entre dans le DAM avec ses métadonnées : nom du photographe, droits d’usage, date de prise de vue, client, brief de campagne. Puis elle est téléchargée, compressée, partagée par email, publiée sur un réseau social, intégrée dans une présentation, réexportée dans un autre format. À chaque étape, une couche d’information disparaît. À l’arrivée, l’image est souvent nue : un fichier sans nom, sans source, sans histoire.

Ce n’est pas une hypothèse. En 2018, Imatag a analysé 50 000 images sur 750 sites web et constaté que 80 % d’entre elles avaient perdu l’intégralité de leurs métadonnées en transit. Pas à cause d’attaques malveillantes. Simplement à cause de la mécanique ordinaire d’internet : compression automatique, pipelines d’upload des plateformes, conversion de formats. Les informations censées établir l’origine d’une image n’avaient pas survécu au voyage.

Le DAM, aussi bien configuré soit-il, ne peut pas contrôler ce qui se passe après que le fichier en est sorti. Et c’est précisément là que le problème commence.

Le problème que tout le monde connaissait et que personne n’a résolu

Les métadonnées IPTC, ces champs standardisés qui intègrent le nom du créateur, le copyright et la légende dans un fichier image depuis les années 1990, ont toujours souffert d’un défaut fondamental : elles étaient conçues pour être transportées, pas pour être vérifiées. N’importe qui pouvait écrire n’importe quoi dans ces champs. Rien ne le détectait. Rien ne le signalait.

Autrement dit : toute l’infrastructure d’attribution des images dans la photographie professionnelle, sur laquelle rédactions, agences de stock et éditeurs ont construit leurs workflows pendant trente ans, reposait sur un système déclaratif sans vérification. Vous affichiez votre nom comme créateur. On vous croyait. Sans contrôle cryptographique, sans liaison persistante, sans moyen de détecter une modification en aval.

Pour une équipe DAM, cela se traduit par un problème opérationnel concret : dès qu’un actif quitte le système, il est impossible de garantir que les informations qui l’accompagnent restent intactes, exactes ou même présentes. La bibliothèque est propre. Le monde extérieur, non.

« Le DAM peut être impeccable. Ce qui se passe après que le fichier en sort échappe complètement à son contrôle. »

Puis l’IA générative est arrivée, et ce problème longtemps latent est devenu bien plus urgent. Quand une image générée par algorithme peut ressembler trait pour trait à une photographie officielle, une déclaration d’un dirigeant, une image de produit, un message marketing, un document gouvernemental, une scène d’actualité, le seul recours est de pouvoir en connaître l’origine. Sans métadonnées, cela devient extrêmement difficile, voire impossible. Et c’est précisément là que la fragilité de trente ans d’infrastructure déclarative révèle toute son ampleur.

Image fiable ou image malicieuse : comment faire la différence ?

C’est la question que tout le monde pose depuis l’avènement de l’IA générative, et à laquelle on répond souvent de travers. On cherche un algorithme de détection qui dirait : « cette image est réelle, celle-là est fausse ». La confiance ne fonctionne pas ainsi.

La vraie question n’est pas : « ces pixels ont-ils été produits par un appareil photo ou par un modèle génératif ?» La vraie question est : « puis-je identifier et vérifier la source de cette image ?»

Une image générée par IA, signée par une marque connue et dont la provenance est cryptographiquement vérifiable, est plus fiable qu’une photographie authentique dont on ne sait plus qui l’a prise, pour qui, ni dans quel contexte. La fiabilité ne réside pas dans les pixels. Elle réside dans la capacité à tracer une chaîne de responsabilité jusqu’à une source identifiable. Et c’est précisément cette capacité que la disparition des métadonnées érode, rendant la question d’autant plus urgente à l’ère de l’IA.

« Ce n’est pas la nature des pixels qui rend une image fiable. C’est la capacité à en retracer l’origine jusqu’à une source identifiable et responsable. »

Comment retrouver l’origine d’une image quand tout a été effacé

C’est la question pratique que se pose tout responsable de contenus visuels : cette image qui circule sur les réseaux, qui apparaît dans un email de partenaire, qui a été réutilisée sans autorisation apparente , d’où vient-elle ? Peut-on encore le savoir quand les métadonnées ont disparu ?

La réponse de la nouvelle génération d’outils est double.

Le filigranage invisible : tracer une image malgré tout

La première approche consiste à ne plus se fier aux métadonnées embarquées dans le fichier, et à intégrer la signature directement dans les pixels de l’image elle-même. C’est le principe du filigranage invisible (ou stéganographie numérique), que des acteurs comme Imatag ont développé et déployé à grande échelle. Le signal intégré dans les pixels survit à la compression, au recadrage, au redimensionnement et même à une capture d’écran. Il ne se voit pas. Il ne peut pas être supprimé par les pipelines d’upload classiques. Et il pointe vers un enregistrement de provenance qui, lui, reste accessible.

Concrètement : une image sort du DAM, traverse dix systèmes différents, perd toutes ses métadonnées IPTC, est recadrée et recompressée. Le filigrane, lui, est toujours là. En le lisant, on peut retrouver qui a créé l’image, quand, pour quel client, et quels droits d’usage lui sont associés. Pour une équipe DAM, c’est la différence entre un actif dont on perd définitivement la trace et un actif que l’on peut retrouver, identifier et, si nécessaire, faire retirer.

Imatag a notamment travaillé avec l’AFP sur des déploiements en rédaction, et leur technologie est l’une des implémentations clés de ce que la norme C2PA appelle la liaison souple : un mécanisme de secours qui permet de retrouver un justificatif de contenu même lorsque toutes les métadonnées conventionnelles ont disparu.

L’empreinte algorithmique : l’image est sa propre signature

La deuxième approche, incarnée par Liccium (construit sur la norme ISO ISCC — International Standard Content Code), va plus loin encore : elle n’intègre rien dans le fichier. Elle dérive une empreinte algorithmique directement du contenu visuel lui-même, et l’enregistre dans un registre public fédéré. L’empreinte ne peut pas être supprimée parce qu’elle est l’image, mathématiquement parlant. Même sans aucune métadonnée, le contenu visuel lui-même devient sa propre preuve d’identité. Cette approche est particulièrement adaptée à la gestion de grandes bibliothèques d’actifs qui circulent dans de nombreux systèmes, et à la déclaration de droits ou d’opt-out pour les données d’entraînement de l’IA.

La signature cryptographique : C2PA comme standard de référence

C’est précisément ce que propose C2PA (Coalition for Content Provenance and Authenticity), la norme développée sous la Linux Foundation avec Adobe, Microsoft, la BBC, Intel et Truepic comme membres fondateurs, et désormais étendue à Amazon, Google et Meta. C2PA définit comment les informations de provenance sont structurées, signées et attachées à un fichier média sous forme de Content Credential.

Le mécanisme est similaire à celui qui sécurise les connexions HTTPS : une autorité de certification vérifie l’identité d’une organisation, lui délivre un certificat, et cette organisation signe ses contenus avec ce certificat.

Quand une image porte un Content Credential signé par Reuters, vous ne pouvez pas modifier ce justificatif sans briser le sceau cryptographique. La signature prouve l’origine. Elle ne garantit pas la vérité de ce que l’image représente, mais elle établit qui en est responsable.

Pour les équipes DAM, l’implication est directe : il devient possible de distinguer automatiquement, à l’entrée ou à la sortie du système, les actifs dont la provenance est vérifiable de ceux qui n’en ont aucune. C’est une couche de conformité et de traçabilité que les métadonnées déclaratives n’ont jamais pu offrir.

JPEG Trust : quand la norme ISO s’en mêle

Au-dessus de C2PA dans la hiérarchie des normes se trouve JPEG Trust (ISO/CEI 21617), publié en janvier 2025. Cette norme internationale formelle étend C2PA à toute la famille des formats JPEG, qui représentent l’écrasante majorité des contenus visuels en circulation dans les organisations. Sa structure multi-parties prévoit notamment une couche de filigranage comme mécanisme de liaison, ce qui en fera, à terme, une couche d’interopérabilité directe avec des outils tels qu’Imatag.

OpenOrigins : prouver ce qui a changé

OpenOrigins et son Human-Oriented Proof System (HOPrS), désormais un lab open source de la Linux Foundation, adoptent une approche différente encore : forensique. Le système cartographie précisément où, au niveau des quadrants de pixels, une image a été modifiée par rapport à son original enregistré. Pas de chaîne de provenance, pas de signature d’organisation, une preuve visuelle et vérifiable de ce qui a changé et où. Pour identifier une image manipulée, c’est une approche complémentaire et particulièrement puissante.

SEAL : une alternative sans autorité centrale

Le Dr Neal Krawetz, chercheur en forensique numérique, a développé une alternative à C2PA appelée SEAL (Secure Evidence Attribution Label). Là où C2PA s’appuie sur des autorités de certification commerciales, SEAL utilise le DNS, gratuit, décentralisé, et conçu pour préserver la vie privée par défaut. Pleinement fonctionnel, il est actuellement évalué aux côtés de C2PA par le Provenance and Authenticity Standards Assessment Working Group de l’Université du Maryland. Il n’a pas encore atteint une adoption massive, mais représente une option sérieuse pour les organisations réticentes aux infrastructures de certification centralisées.

Ce que cela change concrètement pour les équipes DAM

Ces outils ne sont pas des projets de laboratoire. Les déploiements sont déjà en cours.

Les appareils photo Nikon, Leica, Sony et Canon intègrent désormais C2PA au moment de la capture. Le pipeline d’export d’Adobe Creative Cloud peut embarquer des Content Credentials par défaut. L’AFP et Imatag ont un déploiement live sur les workflows de photographie d’agence. Un programme de conformité C2PA formel a été lancé en juin 2025 lors du Content Authenticity Summit de Cornell Tech, créant une liste de confiance officielle pour les organisations signataires. La loi californienne AB 853 imposera aux nouveaux appareils d’enregistrement de proposer des options de données de provenance à partir de juillet 2026.

Pour un DAM manager, les questions pratiques deviennent :

— Nos actifs sont-ils filigrannés avant de quitter le système ?

— Notre DAM est-il capable d’ingérer et de lire des Content Credentials C2PA ?

— Pouvons-nous distinguer automatiquement, à l’entrée, les actifs dont la provenance est vérifiable de ceux qui n’en ont aucune ?

— En cas de réutilisation non autorisée d’un actif sur le web, disposons-nous des outils nécessaires pour en retrouver la trace ?

Les lacunes restent réelles : l’adoption par les plateformes sociales est inégale, tous les réseaux ne préservent pas les justificatifs, et les outils de vérification ne sont pas encore accessibles au grand public. Mais la direction est claire et irréversible. Pour la première fois, il est techniquement possible de construire une chaîne de confiance qui ne s’arrête pas à la porte du DAM.

« Pour la première fois, il est techniquement possible de construire une chaîne de confiance qui ne s’arrête pas à la porte du DAM. »